Automatisierungs- und KI-Verfahren in der öffentlichen Verwaltung können Angebote und Prozesse verbessern. Dazu sind aber gute Planung, fachkundige Teams und ein gründliches Abwägen der Risiken notwendig. Ein Workshop widmete sich der Frage, wie sich das in der Praxis umsetzen lässt.

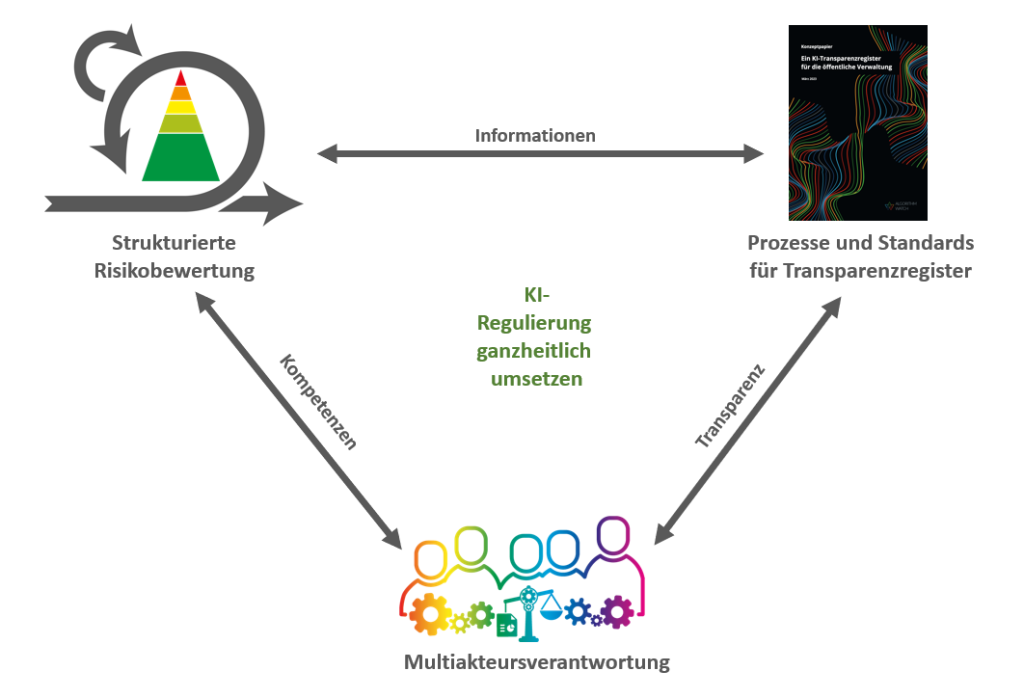

Der Workshop „Strukturierte Risikobetrachtung für ADM/KI-Systeme in der öffentlichen Verwaltung“ wurde von NExT e.V. und AlgorithmWatch organisiert. Die sieben Teilnehmerinnen kamen aus der Verwaltungspraxis und Wissenschaft. Sie tauschten sich darüber aus, wie eine strukturierte Risikobewertung und ein KI-Transparenzregister dabei helfen könnten, Potenziale von KI und automatisierten Entscheidungssystemen sinnvoll für die Verwaltung zu nutzen. Ein fiktives Fallbeispiel diente dazu, Kriterien für eine systematische Risikobetrachtung zu finden und ihre Umsetzung zu planen. Die Teilnehmerinnen konnten außerdem ein Tool zur KI-Risikoabschätzungen in der öffentlichen Verwaltung ausprobieren.

Transparenz schafft Vertrauen

Die Expertinnen brachten ihr Wissen aus der Verwaltungspraxis ein. Sie betonten, dass die Entwicklung und der Einsatz von KI-Systemen für die öffentlichen Verwaltung transparent und verantwortungsbewusst sein müsse und viele Stakeholder beteiligt werden sollten.

Sie waren sich darüber einig, dass der Einsatz von automatisierten Entscheidungssystemen das Vertrauen der Bevölkerung erfordere. Daher sei ein vorsichtiges und transparentes Vorgehen geboten, um Grundrechte wie die Diskriminierungsfreiheit zu schützen. Der Staat habe nämlich hier eine rechtliche Verpflichtung zu erfüllen und müsse seiner Verantwortung gerecht werden.

In diesem Zusammenhang wurde das Konzept eines KI-Transparenzregisters diskutiert. Darin sollten wesentliche Informationen zu KI-Systemen in der öffentlichen Verwaltung öffentlich zugänglich gemacht werden. Dazu muss ein Verfahren etabliert werden, das den Behörden bei der Konzeption und Entwicklung ihrer algorithmischen Systeme hilft. Ein KI-Transparenzregister mit einer Risikoabschätzung könnte die Digitalkompetenzen der Behörden stärken, Bürgerrechte schützen sowie Zuständigkeiten und Unterstützungsbedarf klären.

Fallstudie Risikobewertung

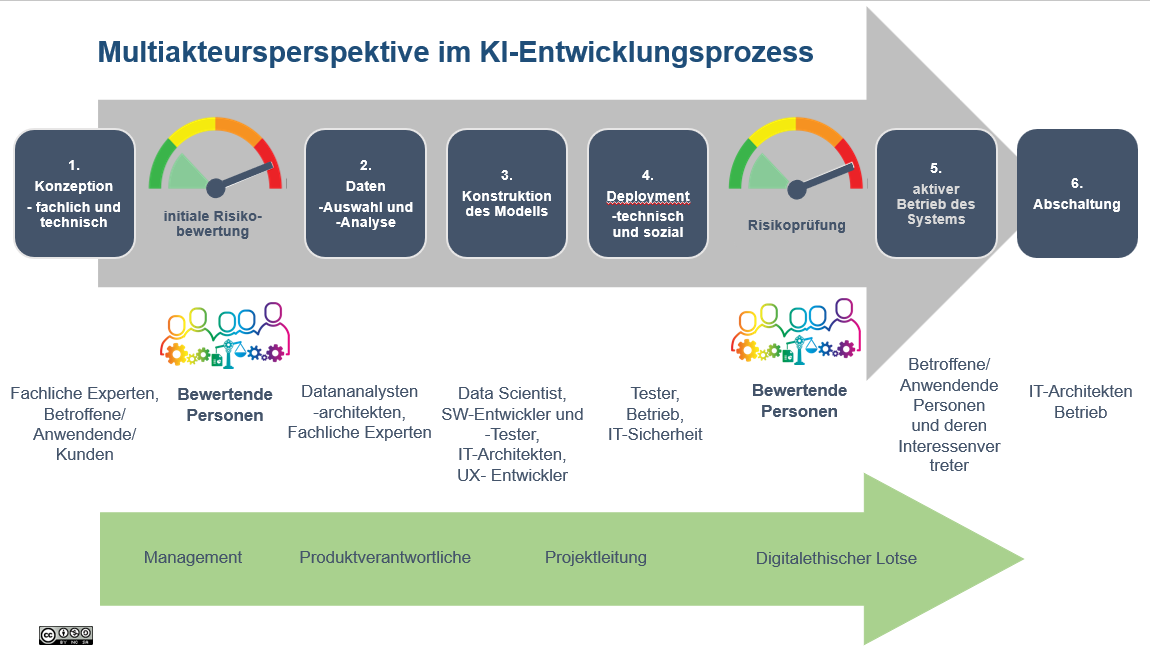

Im fiktiven Fallbeispiel „SMART MATCH AI“ ging es um ein KI-System, das Profile von Erwerbslosen „effizienter“ zu offenen Stellen zuordnen sollte. Die Teilnehmerinnen führten mit diesem Szenario eine strukturierte Risikobewertung durch und bestimmten die Voraussetzungen, die bei der Entwicklung eines KI-Systems erfüllt sein müssen. Dabei wurde ein von AlgorithmWatch entwickeltes Online-Tool vorgestellt, das sich für eine systematische und leicht anwendbare Folgenabschätzung nutzen lässt.

In einer Gruppenübung analysierten die Teilnehmerinnen die wichtigsten Fragen, die das Tool aufwirft: Welches Ziel soll mit dem System erreicht werden und welchen Nutzen hat es? Welche Risiken können auftreten und von welchen Faktoren hängen sie ab? Welche Probleme ergeben sich aus der Datengrundlage und wie lassen sich Diskriminierungsrisiken ausschließen? In der Diskussion wurde deutlich, dass Risiken system- und kontextabhängig entstehen. Eine Folgenabschätzung sollte daher immer beim konkreten Nutzungszusammenhang ansetzen.

Multiakteursperspektive in der Praxis

In weiteren Übungen kamen zusätzliche praktische Herausforderungen zur Sprache:

- Ein KI-Transparenzregister sollte aussagekräftige und vertrauensbildende Informationen enthalten. Sie sollten frühzeitig und strukturiert ermittelt werden und umfassend sein.

- Der Zeitpunkt ist entscheidend: Je früher relevante Daten im KI-Entwicklungsprozess durch eine Folgenabschätzung erhoben werden, desto leichter wird später die Umsetzung der neuen KI-Verordnung der EU fallen. Auf diese Weise würden die Beteiligten vermeiden, ihren Fehler bei der Einführung der Datenschutz-Grundverordnung zu wiederholen und nicht ausreichend vorbereitet zu sein.

- Teamarbeit ist gefragt: Bei der Einführung automatisierter Systeme müssen rechtliche, ethische und gesellschaftliche Anforderungen von Beginn an reflektiert und im Entwicklungsprozess berücksichtigt werden. Dazu ist ein vielfältiges, aber nicht zu großes Team aus Expert*innen nötig.

KI-Verordnung setzt den Rahmen

Die KI-Verordnung der EU definiert den rechtlichen Rahmen für ein öffentliches KI-Register. Es ist die Aufgabe von Expert*innen aus der Verwaltung, Zivilgesellschaft und Wissenschaft, die Verordnung umzusetzen und effektiv zu nutzen. Unser Workshop hat bewiesen, dass unterschiedliche Menschen aus Behörden ein Interesse daran haben, an der Entwicklung von KI-Systemen für die öffentliche Verwaltung mitzuwirken − sei es durch das Ausarbeiten von Verfahren zur Folgenabschätzung oder bei der Gestaltung eines nationalen KI-Transparenzregisters.

Beitragsbild von ha11ok auf Pixabay